🚀 LaMini-Flan-T5-783M

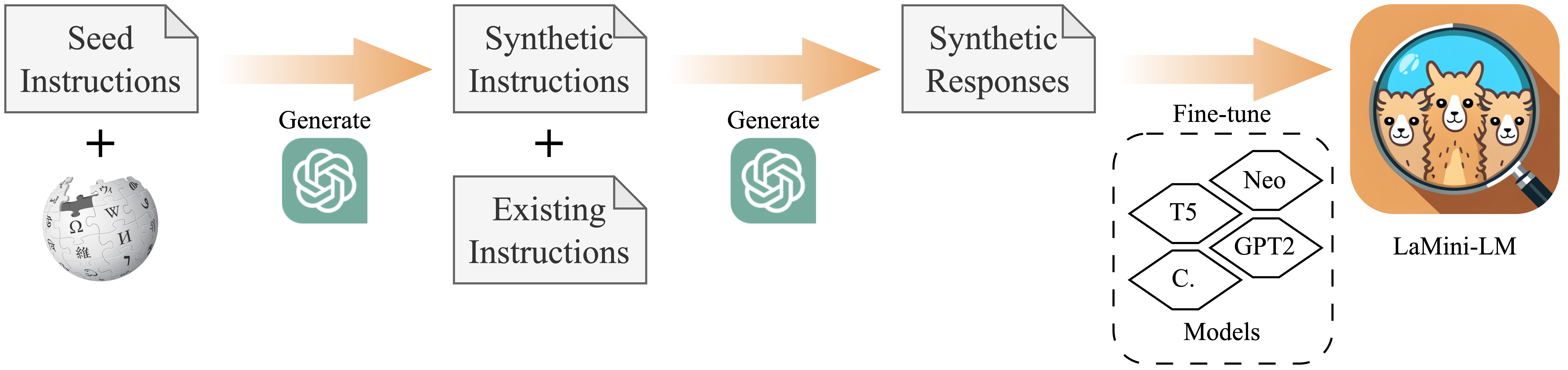

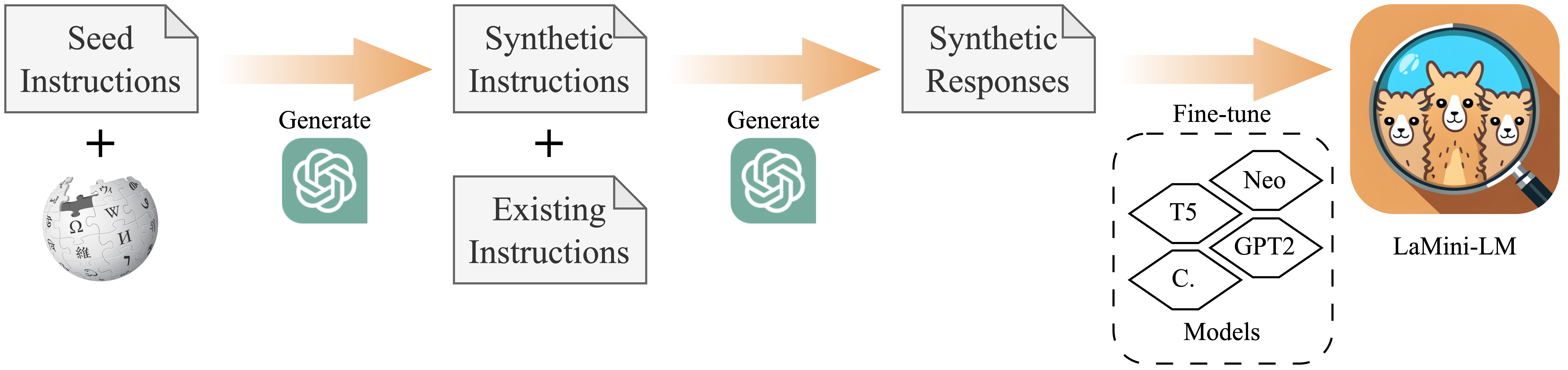

LaMini-Flan-T5-783M 是 LaMini-LM 模型系列中的一员,基于大规模指令进行蒸馏得到。它在文本生成任务上表现出色,能根据自然语言指令生成高质量的回复。

🚀 快速开始

本模型推荐用于响应自然语言编写的人类指令。下面展示如何使用 HuggingFace 的 pipeline() 加载和使用该模型:

from transformers import pipeline

checkpoint = "{model_name}"

model = pipeline('text2text-generation', model = checkpoint)

input_prompt = 'Please let me know your thoughts on the given place and why you think it deserves to be visited: \n"Barcelona, Spain"'

generated_text = model(input_prompt, max_length=512, do_sample=True)[0]['generated_text']

print("Response", generated_text)

✨ 主要特性

- 指令微调:在包含 258 万个样本的 LaMini-instruction 数据集上进行微调,能更好地响应自然语言指令。

- 模型系列丰富:LaMini-LM 系列包含多种基于不同基础模型的变体,可根据需求选择。

📦 安装指南

使用前需安装必要的库,可通过以下命令安装:

pip install -q transformers

💻 使用示例

基础用法

from transformers import pipeline

checkpoint = "{model_name}"

model = pipeline('text2text-generation', model = checkpoint)

input_prompt = 'Please let me know your thoughts on the given place and why you think it deserves to be visited: \n"Barcelona, Spain"'

generated_text = model(input_prompt, max_length=512, do_sample=True)[0]['generated_text']

print("Response", generated_text)

📚 详细文档

模型信息

本模型是 google/flan-t5-large 在 LaMini-instruction 数据集 上的微调版本,总参数数量为 7.83 亿。

模型系列

你可以查看 LaMini-LM 系列的其他模型,带有 ✩ 的模型在其规模/架构下整体性能最佳,推荐使用。更多细节可参考论文。

训练过程

模型使用 [google/flan-t5-large](https://huggingface.co/google/flan-t5-large) 初始化,并在 [LaMini-instruction 数据集](https://huggingface.co/datasets/MBZUAI/LaMini-instruction) 上进行微调。

训练超参数

训练过程中使用了以下超参数:

- 学习率:0.0005

- 训练批次大小:128

- 评估批次大小:64

- 随机种子:42

- 梯度累积步数:4

- 总训练批次大小:512

- 优化器:Adam(β1 = 0.9,β2 = 0.999,ε = 1e-08)

- 学习率调度器类型:线性

- 训练轮数:5

评估

我们进行了两组评估:下游 NLP 任务的自动评估和面向用户指令的人工评估。更多细节请参考 论文。

局限性

更多信息待补充。

🔧 技术细节

本模型基于 Transformer 架构,通过在大规模指令数据集上的微调,学习到了自然语言的模式和语义信息,从而能够更好地响应人类指令。

📄 许可证

本模型采用 CC By NC 4.0 许可证。

引用

@article{lamini-lm,

author = {Minghao Wu and

Abdul Waheed and

Chiyu Zhang and

Muhammad Abdul-Mageed and

Alham Fikri Aji

},

title = {LaMini-LM: A Diverse Herd of Distilled Models from Large-Scale Instructions},

journal = {CoRR},

volume = {abs/2304.14402},

year = {2023},

url = {https://arxiv.org/abs/2304.14402},

eprinttype = {arXiv},

eprint = {2304.14402}

}

Transformers 支持多种语言

Transformers 支持多种语言 Transformers 支持多种语言

Transformers 支持多种语言 Transformers 英语

Transformers 英语 Transformers 英语

Transformers 英语