🚀 Llama-3-Typhoon-1.5-8B:泰语大语言模型(指令型)

Llama-3-Typhoon-1.5-8B-instruct 是一个拥有 80 亿参数的泰语 🇹🇭 指令型大语言模型,它基于 Llama3-8B 构建。

有关发布文章,请查看我们的 博客。

*为了认可 Meta 在创建基础模型方面的努力并遵守许可协议,我们在模型名称中明确包含了 "llama-3"。

✨ 主要特性

- 模型类型:基于 Llama 架构的 80 亿参数指令型仅解码器模型。

- 依赖要求:transformers 4.38.0 或更高版本。

- 主要语言:泰语 🇹🇭 和英语 🇬🇧

- 许可证:Llama 3 社区许可证

📊 性能表现

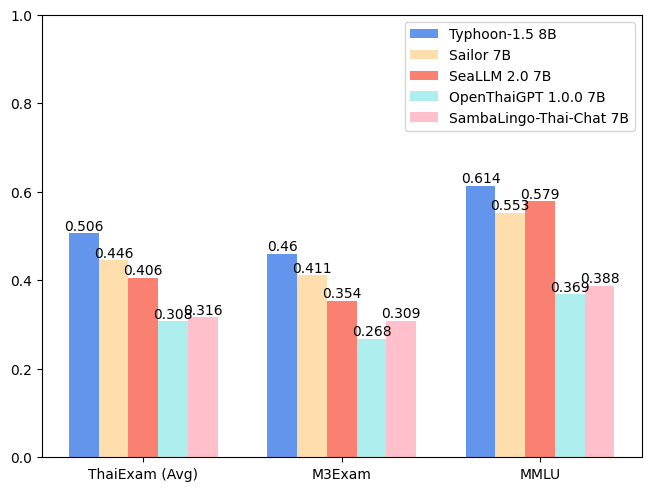

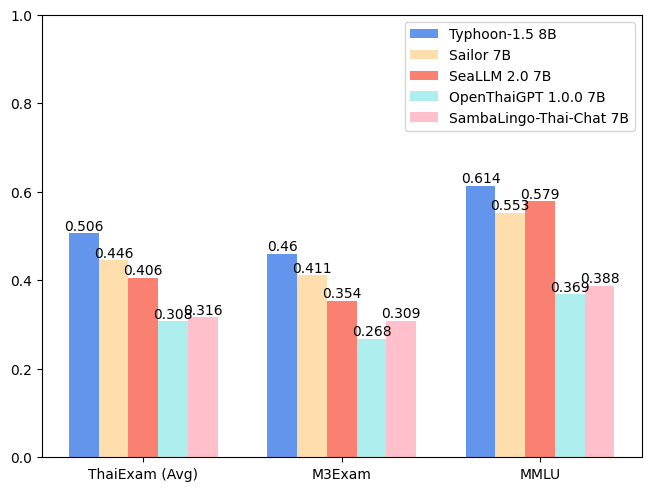

| 模型 |

ONET |

IC |

TGAT |

TPAT-1 |

A-Level |

平均(泰语考试) |

M3Exam |

MMLU |

| Typhoon-1.0(Mistral) |

0.379 |

0.393 |

0.700 |

0.414 |

0.324 |

0.442 |

0.391 |

0.547 |

| Typhoon-1.5 8B(Llama3) |

0.446 |

0.431 |

0.722 |

0.526 |

0.407 |

0.506 |

0.460 |

0.614 |

| Sailor 7B |

0.372 |

0.379 |

0.678 |

0.405 |

0.396 |

0.446 |

0.411 |

0.553 |

| SeaLLM 2.0 7B |

0.327 |

0.311 |

0.656 |

0.414 |

0.321 |

0.406 |

0.354 |

0.579 |

| OpenThaiGPT 1.0.0 7B |

0.238 |

0.249 |

0.444 |

0.319 |

0.289 |

0.308 |

0.268 |

0.369 |

| SambaLingo - Thai - Chat 7B |

0.251 |

0.241 |

0.522 |

0.302 |

0.262 |

0.316 |

0.309 |

0.388 |

💻 使用示例

基础用法

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

model_id = "scb10x/llama-3-typhoon-v1.5-8b-instruct"

tokenizer = AutoTokenizer.from_pretrained(model_id)

model = AutoModelForCausalLM.from_pretrained(

model_id,

torch_dtype=torch.bfloat16,

device_map="auto",

)

messages = [

{"role": "system", "content": "You are a helpful assistant who're always speak Thai."},

{"role": "user", "content": "ขอสูตรไก่ย่าง"},

]

input_ids = tokenizer.apply_chat_template(

messages,

add_generation_prompt=True,

return_tensors="pt"

).to(model.device)

terminators = [

tokenizer.eos_token_id,

tokenizer.convert_tokens_to_ids("<|eot_id|>")

]

outputs = model.generate(

input_ids,

max_new_tokens=512,

eos_token_id=terminators,

do_sample=True,

temperature=0.4,

top_p=0.9,

)

response = outputs[0][input_ids.shape[-1]:]

print(tokenizer.decode(response, skip_special_tokens=True))

聊天模板

我们使用 llama3 聊天模板。

{% set loop_messages = messages %}{% for message in loop_messages %}{% set content = '<|start_header_id|>' + message['role'] + '<|end_header_id|>\n\n'+ message['content'] | trim + '<|eot_id|>' %}{% if loop.index0 == 0 %}{% set content = bos_token + content %}{% endif %}{{ content }}{% endfor %}{% if add_generation_prompt %}{{ '<|start_header_id|>assistant<|end_header_id|>\n\n' }}{% endif %}

📚 详细文档

预期用途与局限性

此模型是一个指令型模型,但仍在开发中。它包含了一定程度的防护机制,但在响应用户提示时仍可能产生不准确、有偏见或其他令人反感的答案。我们建议开发人员在其用例的背景下评估这些风险。

关注我们

https://twitter.com/opentyphoon

支持渠道

https://discord.gg/us5gAYmrxw

SCB10X AI 团队

- Kunat Pipatanakul, Potsawee Manakul, Sittipong Sripaisarnmongkol, Natapong Nitarach, Pathomporn Chokchainant, Kasima Tharnpipitchai

- 如果您发现 Typhoon - 8B 对您的工作有用,请使用以下方式引用它:

@article{pipatanakul2023typhoon,

title={Typhoon: Thai Large Language Models},

author={Kunat Pipatanakul and Phatrasek Jirabovonvisut and Potsawee Manakul and Sittipong Sripaisarnmongkol and Ruangsak Patomwong and Pathomporn Chokchainant and Kasima Tharnpipitchai},

year={2023},

journal={arXiv preprint arXiv:2312.13951},

url={https://arxiv.org/abs/2312.13951}

}

联系我们

📄 许可证

本模型使用 Llama 3 社区许可证。

Transformers 支持多种语言

Transformers 支持多种语言 Transformers 支持多种语言

Transformers 支持多种语言 Transformers 英语

Transformers 英语 Transformers 英语

Transformers 英语